Como funcionam os Modelos de Linguagem de Grande Escala (LLMs)?

Dando seguimento aos temas relacionados à Inteligência Artificial, falaremos agora sobre os Modelos de Linguagem de Grande Escala ou LLMs (Large Language Models).

Um LLM é criado com uma quantidade muito grande de dados e palavras (milhões de milhões), de forma que ele pode prever o que o usuário quer dizer e completar frases, assim como aprender de maneira evolutiva.

Esses modelos são treinados com grandes volumes de dados da internet e aprendem padrões de como as palavras e frases são comumente usadas juntas. Quando é fornecida uma nova entrada de texto, um LLM tentará prever ou gerar a continuação mais provável desse texto com base no que aprendeu durante o treinamento. Esses modelos são treinados com grandes quantidades de dados de texto para aprender padrões e relações entre entidades no idioma.

Eles podem compreender dados textuais complexos, identificar entidades e relações entre elas e gerar novos textos que sejam coerentes e gramaticalmente precisos.

Embora os princípios matemáticos por trás desses LLMs possam ser sistemas complexos, uma compreensão básica da arquitetura utilizada para implementá-los pode ajudar a entender melhor os conceitos de como funcionam.

Os modelos de grande escala se baseiam na arquitetura de transformador, que se apoia e amplia algumas técnicas que se mostraram bem-sucedidas na modelagem de vocabulários para apoiar tarefas de PNL e, particularmente, na geração de linguagem.

Os modelos de transformadores são treinados com grandes volumes de texto, permitindo que representem as relações semânticas entre as palavras e usem essas relações para determinar sequências prováveis de texto que façam sentido.

- Um bloco codificador que cria representações semânticas do vocabulário de treinamento.

- Um bloco decodificador que gera novas sequências de linguagem.

Na prática, as implementações específicas da arquitetura variam: por exemplo, o modelo BERT (Bidirectional Encoder Representation from Transformers) desenvolvido pelo Google para o motor de busca de suporte usa apenas blocos codificadores, enquanto o modelo GPT (Generative Pre-trained Transformer) desenvolvido pela OpenAI usa apenas o bloco decodificador.

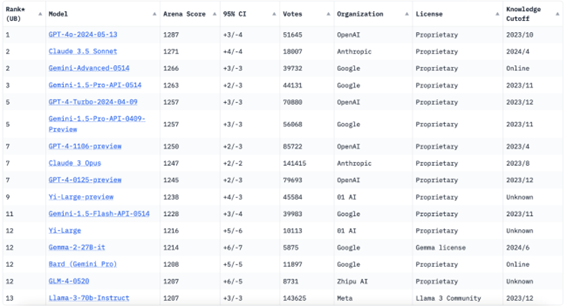

A seguir, apresentamos alguns dos modelos de linguagem grandes mais relevantes atualmente. São modelos que realizam processamento de linguagem natural e influenciam a arquitetura de modelos futuros.

De acordo com o ranking do Chatbot Arena até hoje, estes são os TOP LLMs:

Foca na IA constitucional, que molda os resultados da IA por meio de um conjunto de princípios que ajudam o assistente de IA a ser útil, inofensivo e preciso. Claude foi criado pela empresa Anthropic.

É um modelo "generativo", projetado para prever a próxima palavra em uma sequência de texto dada a sequência anterior. O GPT utiliza uma abordagem unidirecional para o treinamento, processando o texto da esquerda para a direita ou de maneira sequencial e aprendendo a gerar texto com base no que já viu.

Projetado como um modelo de "compreensão" da linguagem, o BERT processa o texto de maneira bidirecional, ou seja, aprende o contexto de uma palavra com base em todas as outras palavras de uma frase. Utiliza uma técnica chamada MLM ou Masked Language Model, na qual algumas palavras da entrada são ocultadas ou mascaradas. Nesse ambiente, o modelo tenta prever essas palavras com base no contexto fornecido pelas palavras não ocultas.

Os modelos Gemini são multimodais, o que significa que podem lidar com imagens, áudio e vídeo, além de texto. O Gemini também está integrado em várias aplicações e produtos do Google. O modelo substituiu o Palm na alimentação do chatbot, que passou a ser chamado de Bard após a mudança de modelo.

É uma família de modelos de linguagem de código aberto da Google que foram treinados com os mesmos recursos do Gemini. Os modelos Gemma podem ser executados localmente em um computador pessoal.

Large Language Model Meta AI (Llama) é o LLM da Meta lançado em 2023. O Llama foi lançado originalmente para pesquisadores e desenvolvedores aprovados, mas agora é de código aberto.

Embora os LLMs sejam um fenômeno recente, seus precursores remontam a décadas atrás. Descubra como o precursor recente Seq2Seq e o precursor distante ELIZA prepararam o cenário para os LLMs modernos.

Qual é o futuro dos LLMs?

A introdução de modelos de linguagem de grande escala, como ChatGPT, Claude e Llama, que podem responder perguntas e gerar textos, aponta para possibilidades interessantes no futuro. Lentamente, mas de forma constante, os LLMs estão atingindo um desempenho semelhante ao humano. O sucesso imediato desses LLMs demonstra grande interesse em LLMs do tipo robótico que emulam e, em alguns contextos, superam o cérebro humano. A seguir, são mencionadas algumas reflexões sobre o futuro dos LLMs:

- Maiores Capacidades

- Treinamento audiovisual

- Transformação do local de trabalho

- IA Conversacional

Ricardo Oliveira

Head Tech & Innovation

Autor

FAQ

Os LLMs são treinados com grandes volumes de dados textuais para prever e gerar sequências significativas. Eles utilizam a arquitetura de transformadores, que ajuda a entender e gerar texto ao aprender relações semânticas.

O BERT é bidirecional e projetado para compreensão de linguagem, enquanto o GPT é unidirecional e generativo, focado em prever a próxima palavra em uma sequência.

Os modelos mais populares incluem Claude (Anthropic), GPT (OpenAI), BERT (Google), Gemini (Google) e LLAMA (Meta), usados para tarefas como geração de texto, compreensão e processamento multimodal.

Dialogi AI

Descubra como nossas soluções com empat.IA podem revolucionar o atendimento ao cliente no seu negócio.

Post Recentes

- All Posts

- Design e Comunicação

- Design y Comunicación

- Ética e Sociedade

- Evolução e Impacto da IA

- Experiência do Cliente

- Inteligência Artificial

- Outros

- Sem categoria

Categorias

Tags

Dialogi | IA | Interação Humano-Máquina | Assistentes Virtuais | Automação | Futuro da Tecnologia | Comunicação Digital